一元线性回归

基本方程:

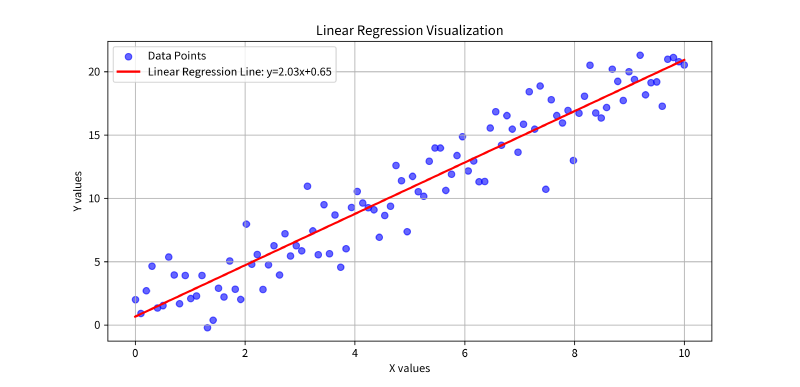

$$ y = \beta_{0} + \beta_{1}x $$当给定参数$\beta_{0}$和$\beta_{1}$后,函数图像呈现一条直线。当我们只用一个$x$来预测$y$,就是一元线性回归,但在一般条件下,这两个参数是未知的,我们知道的只有$x$和$y$,在二维图像上表现为一个个单独的点,线性回归就是要找到一条直线,尽可能让这条线去拟合图中的点(即所有的$x$和$y$的组合)。

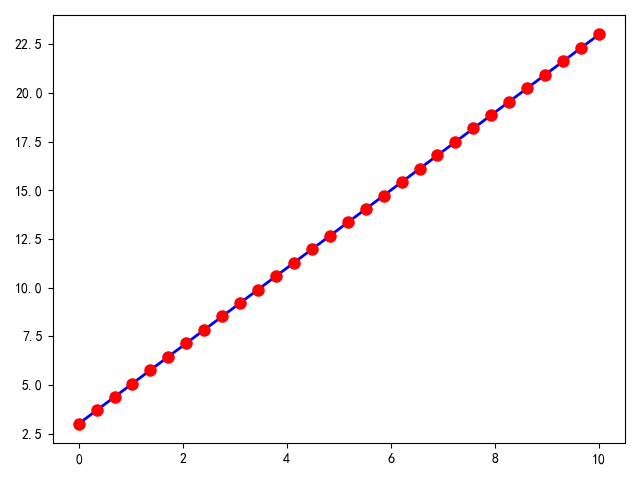

这是非常理想的情况下,在实际中,数据点会十分散乱,线性回归就是在杂乱中寻找规律:

损失函数

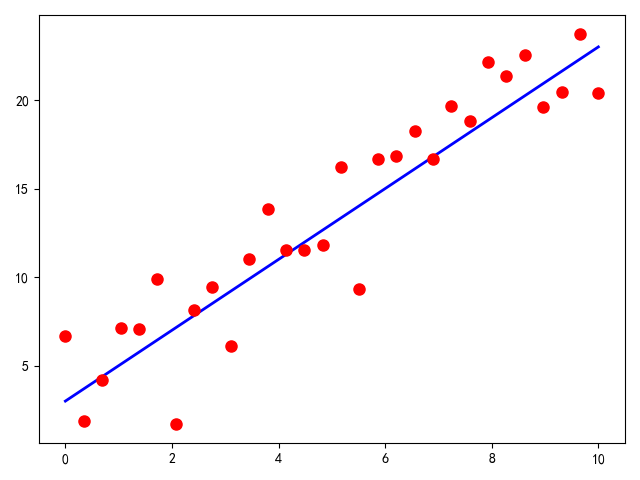

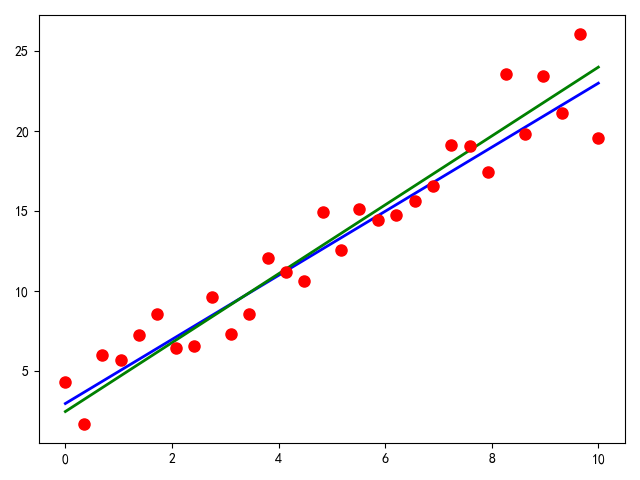

既然是用直线拟合散点,为什么最终得到的直线是蓝色的那根而不是绿色的,散点都在这两条线附近,所以我们需要一个评判标准,用于评价哪条才是最“合适”的。

一个很直观的标准就是看哪条线和散点之间的偏差最大,也就是真实值和预测值间的差值,即残差,用公式表示即:

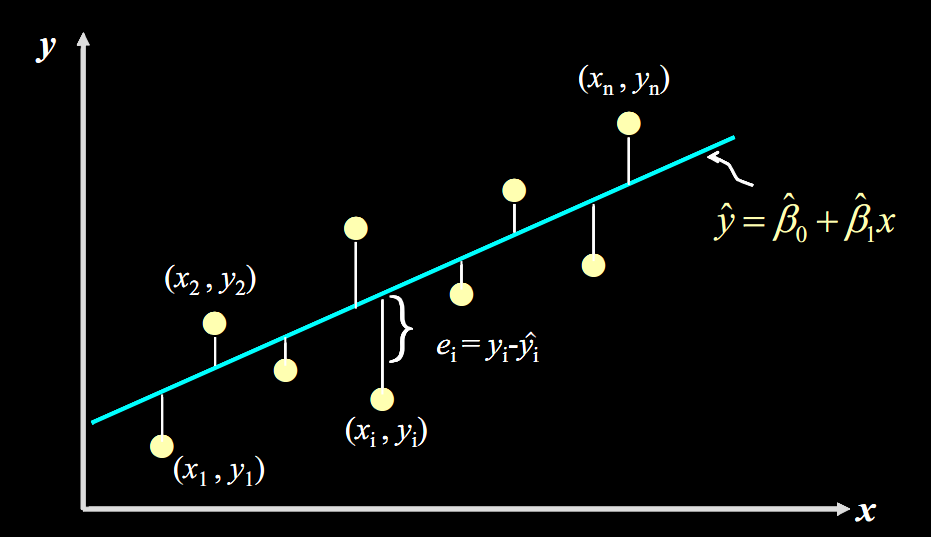

$$ e = y - \hat{y} $$图像表示为:

对于我们数据中的每个点如此计算一遍,再将所有的$e_{i}^{2}$相加,就能量化出拟合的直线和实际之间的误差。公式表示为:

$$ Q=\sum_{i=1}^{n}(y_{i}-\hat{y}_{i})^{2}=\sum_{i=1}^{n}(y_{i}-(\hat{\beta}_{0}+\hat{\beta}_{1}x_{i}))^{2} $$这个公式是残差平方和,即SSE(Sum of Squares for Error),在机器学习中它是回归问题中最常用的损失函数。

现在我们知道了损失函数是衡量回归模型误差的函数,也就是我们要的“直线”的评价标准。这个函数的值越小,说明直线越能拟合我们的数据。

最小二乘估计

最小二乘估计是用来计算$\beta_{0}$和$\beta_{1}$的方法,我们知道,两点确定一线,有两组x,y的值,就能算出来$\beta_{0}$和$\beta_{1}$。但是现在我们有很多点,且并不正好落在一条直线上,这么多点每两点都能确定一条直线,这到底要怎么确定选哪条直线呢?

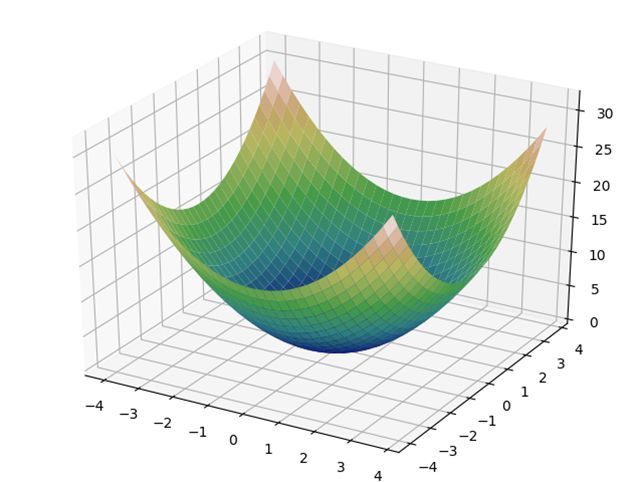

将一切回归到评价准则,对于一条最适合的线,其损失函数的值一定是最小的,对于一个一元二次函数,其导函数为0的点处取到最小函数值,而在损失函数中,存在两个变量,为二元二次函数,其函数图像大致为:

在微积分中,若闭区间内是凹函数,则极小值即为最小值,导数为0时,Q取最小值,因此对两个未知量求偏导,令其为0,则:

$$ \frac{\partial Q}{\partial\beta_{0}}=2\sum_{i=1}^{n}\left(y_{i}-\hat{\beta}_{0}-\hat{\beta}_{1}x_{i}\right)=0 $$$$ \frac{\partial Q}{\partial\beta_{1}}=2\sum_{i=1}^{n}\left(y_{i}-\hat{\beta}_{0}-\hat{\beta}_{1}x_{i}\right)x_{i}=0 $$将散点值代入,即可求得。